Il est 23h et je scrolle encore. Je le sais, je le vois, mes doigts continuent. Rien de dramatique : je ne suis ni accro ni fragile, je suis juste la cible d’un système qui a été affiné depuis vingt ans pour faire exactement ce qu’il vient de faire. Me retenir.

Dans l’article précédent de cette série, j’ai regardé comment nos peurs — rater, être seul, ne pas être à la hauteur, perdre — deviennent des leviers de vente. Les peurs, c’est l’entrée. Cet article-ci ouvre le capot d’un étage plus technique : le design lui-même. Comment une interface tient. Quelles pièces la composent. Pourquoi personne, dans la Silicon Valley des années 2010, n’a construit ces produits « par accident ».

Deux précautions d’usage. D’abord, je ne parle pas d’un complot secret. Je parle d’un artisanat bien documenté, enseigné à Stanford, résumé dans des livres best-sellers, et parfois regretté publiquement par ses inventeurs. Ensuite, décrire le mécanisme ne le désamorce pas. Je connais ces pièces depuis des années et je scrolle quand même. C’est une des choses que cet article essaie d’expliquer.

Ce qui suit est une cartographie : qui a théorisé quoi, quelles études existent vraiment, quelles disputes sont encore ouvertes. L’idée n’est pas de donner à haïr. L’idée est de donner à voir.

L’attention est-elle devenue la ressource rare ?

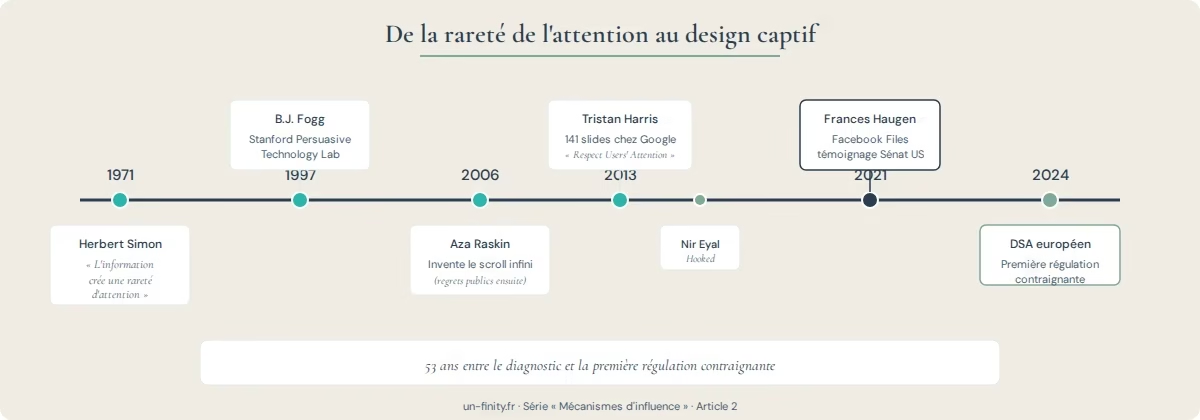

La phrase fondatrice de ce champ date de 1971. FACTUEL Herbert Simon, prix Nobel d’économie, pose une observation toute bête : « une abondance d’information crée une rareté d’attention ». Dans un monde où les contenus sont infinis, ce qui manque n’est plus l’information — c’est la capacité de notre cerveau à la traiter. Cette inversion change tout.

Le sociologue français Yves Citton en a fait le principe d’une nouvelle phase du capitalisme dans L’économie de l’attention (La Découverte, 2014) et dans Pour une écologie de l’attention (Seuil, 2014). Pour lui, l’attention devient « la première rareté et la plus précieuse source de valeur » d’un monde où les biens matériels s’effacent derrière les flux. FACTUEL

Concrètement, ça donne des équations comptables précises. La publicité représente environ 80 % des revenus de Google et 97 % de ceux de Meta. Ces plateformes ne te vendent plus un produit : elles vendent toi — plus exactement, ton attention agrégée et profilée — à des annonceurs. Le modèle tient entièrement là-dessus. FACTUEL

Bruno Patino résume la même idée en une image frappante dans La civilisation du poisson rouge (Grasset, 2019) : notre capacité de concentration moyenne est passée sous la barre des neuf secondes — celle d’un poisson rouge dans son bocal. Le chiffre est médiatique, ses sources scientifiques sont contestées, mais l’intuition est juste : ce qui s’amenuise, c’est le temps continu que nous consacrons à un objet mental unique. EXPLORATOIRE

Pourquoi notre cerveau ancestral cède-t-il à un marché dérégulé ?

Le sociologue Gérald Bronner apporte une profondeur anthropologique à ce diagnostic dans Apocalypse cognitive (PUF, 2021). FACTUEL Sa thèse se tient en deux temps.

Premier temps : nous avons au XXᵉ siècle acquis un « temps de cerveau disponible » sans précédent — fruit de la baisse du temps de travail, de l’allongement de la vie, de la mécanisation domestique. Jamais une génération humaine n’a eu autant de minutes éveillées à dépenser en dehors de la survie immédiate.

Deuxième temps : ce trésor rencontre une « dérégulation massive du marché cognitif ». Les anciennes frictions qui filtraient l’information (religieuses, géographiques, éditoriales) sont tombées. L’offre d’idées est devenue fluide, infinie, instantanée. Et nos biais ancestraux — attirance pour la peur, le sexe, le conflit, les récits simples — trouvent enfin une offre illimitée qui les nourrit en continu.

L’apocalypse, au sens étymologique de « dévoilement », c’est ça : livré à lui-même, notre cerveau préfère spontanément ce qui lui fait du mal. Non pas par faiblesse morale, mais parce qu’il a été câblé, sur des centaines de milliers d’années, pour attraper les signaux saillants — ceux qui auraient pu le tuer ou le nourrir. Dans la savane, cette priorité sauvait la vie. Devant un flux infini optimisé sur ces mêmes signaux, elle la consomme.

L’analogie que je trouve la plus claire est celle de la nourriture. Nos ancêtres étaient préparés à chercher le sucre et la graisse parce que c’étaient des nutriments rares et précieux. Mettez ce cerveau-là devant un rayon d’ultra-transformés, et sa préférence spontanée devient un problème de santé publique. L’économie de l’attention, c’est le même phénomène appliqué aux contenus. EXPLORATOIRE

Les pièces de la machine à accrocher

Maintenant, le cœur technique. Il faut nommer trois personnes et trois concepts pour comprendre comment ces produits sont construits.

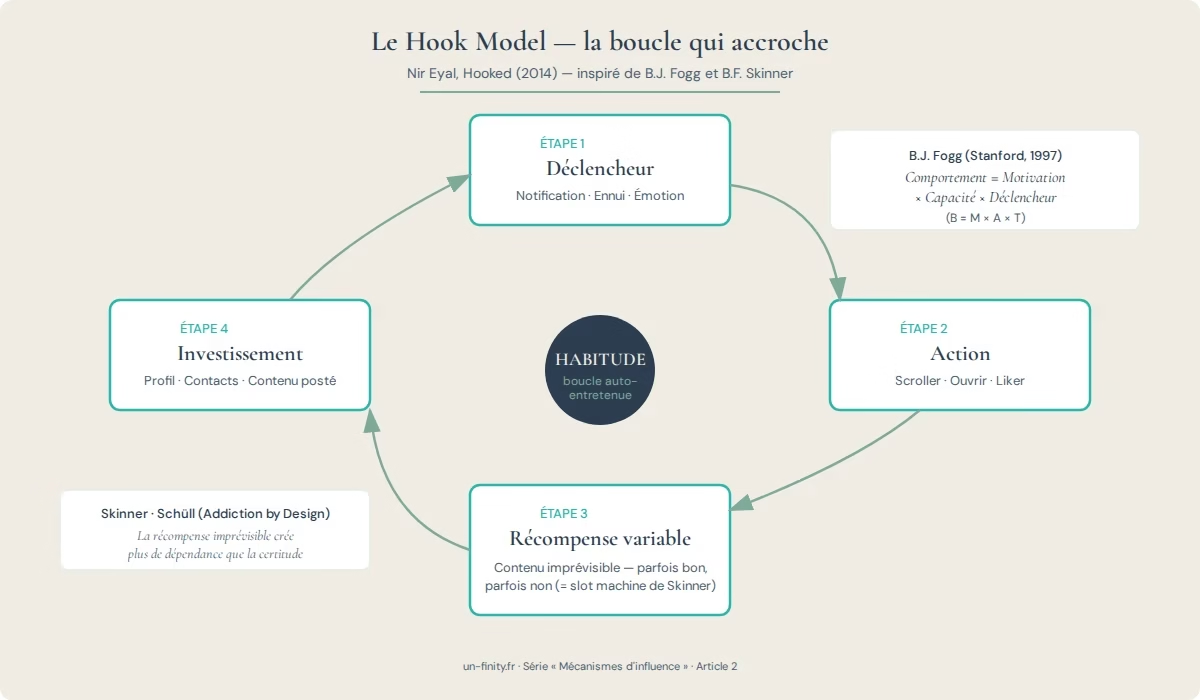

Le premier nom, c’est BJ Fogg. FACTUEL Chercheur à Stanford, il fonde en 1997 un laboratoire appelé d’abord Persuasive Technology Lab, rebaptisé plus tard Behavior Design Lab. En 2009, il publie un article fondateur qui pose une équation devenue la bible du design comportemental : B = MAT — un comportement (Behavior) se produit quand convergent au même instant une Motivation suffisante, une Ability (capacité) suffisante, et un Trigger (déclencheur). Plus tard, dans son livre Tiny Habits (2019), il remplace « Trigger » par « Prompt » — le mot est moins violent, mais la mécanique est la même. Si l’un des trois éléments manque, rien n’a lieu. Si les trois convergent, le comportement se produit.

L’intuition utile du modèle : augmenter la facilité (Ability) est presque toujours plus efficace que pousser la motivation. La motivation fluctue, la simplicité est stable. C’est pour ça que les apps qui marchent ne te demandent pas de « vouloir plus » : elles enlèvent des frictions. Un clic en moins, un champ en moins, un geste en moins. Fogg a enseigné son modèle à Stanford pendant vingt ans. Parmi ses étudiants : Mike Krieger, cofondateur d’Instagram.

Le deuxième nom, c’est Nir Eyal. FACTUEL En 2014, il publie Hooked: How to Build Habit-Forming Products chez Portfolio (Penguin). Le livre devient un best-seller du Wall Street Journal et la feuille de route officieuse d’une génération de product managers. Son modèle, le Hook (l’hameçon), prolonge explicitement celui de Fogg en y ajoutant une boucle. Quatre phases : Trigger (le déclencheur — externe au début, interne après conditionnement), Action (le geste simple : scroller, cliquer, taper), Variable Reward (la récompense imprévisible), Investment (ce que tu laisses dans l’appli — temps, contenu, données — et qui augmente la probabilité du prochain passage dans la boucle).

Le troisième nom, c’est celui d’un psychologue mort en 1990 : B.F. Skinner. FACTUEL Dans les années 1930-1950, Skinner étudiait le renforcement opérant chez des pigeons et des rats. Il a démontré qu’une récompense imprévisible (non pas à chaque pression du levier, mais de temps en temps, de façon aléatoire) produit un comportement plus persistant qu’une récompense prévisible. C’est le principe de la récompense à renforcement variable. C’est aussi, à peu près trait pour trait, le principe de la machine à sous.

L’anthropologue américaine Natasha Dow Schüll, du MIT, a documenté cet artisanat pendant quinze ans dans les casinos de Las Vegas. Dans Addiction by Design (Princeton University Press, 2012), elle décrit ce qu’elle appelle la « machine zone » : un état de transe où le joueur ne joue plus pour gagner mais pour rester dans le jeu. Disparaît le temps, disparaît le corps, disparaît la conscience qu’on a perdu de l’argent. Ce livre parle de casinos. Mais chaque fois qu’un designer d’app parle de « variable reward », il utilise le même vocabulaire. Schüll a d’ailleurs elle-même fait le pont en montrant que les interfaces de smartphone empruntent au design des slots les mécaniques de rétention.

Un cas emblématique condense tout ça : le scroll infini, inventé en 2006 par Aza Raskin alors qu’il travaillait dans une petite société de consulting appelée Humanized Inc. FACTUEL L’idée initiale était une amélioration d’ergonomie — éviter les pages « 2 sur 247 » sur un moteur de recherche. Quand Instagram, Twitter, Facebook l’adoptent quelques années plus tard, la mécanique change de registre : couplée à un flux d’actualités et à une récompense variable, elle devient, de l’aveu même de son inventeur, « behavioral cocaine ». Raskin a depuis exprimé publiquement ses regrets, cofondé avec Tristan Harris le Center for Humane Technology, et témoigné fin 2025 au procès Meta au Nouveau-Mexique contre son propre bébé.

À cet étage du design, il y a aussi les dark patterns — littéralement « motifs sombres ». Ce sont les petites architectures qui orientent subtilement un choix au détriment de l’utilisateur : un bouton « accepter » vert vif, un bouton « refuser » gris petit, une case pré-cochée pour la newsletter, un compte à rebours artificiel. Une étude publiée en 2019 par des chercheurs de Princeton et Chicago a scanné 11 000 sites d’e-commerce et y a recensé 1 818 instances de dark patterns, dont 183 clairement trompeurs. FACTUEL Le phénomène est désormais encadré par le Digital Services Act européen et, en France, par la DGCCRF.

Pourquoi Tristan Harris parle-t-il de « piratage » ?

En février 2013, un employé de Google nommé Tristan Harris écrit une présentation de 141 diapositives intitulée A Call to Minimize Distraction & Respect Users’ Attention. FACTUEL Le document circule en interne, devient viral parmi les salariés, atterrit sur le bureau de Larry Page. Il faudra attendre mai 2018 pour que The Verge en publie l’intégralité.

Harris y identifie cinq vulnérabilités psychologiques que les interfaces exploitent systématiquement.

La première, c’est la mauvaise anticipation : une notification « photo » déclenche dix minutes de défilement. Tu croyais jeter un œil, tu viens de payer en temps. La deuxième, c’est le renforcement à récompense variable — celui de Skinner, appliqué au pull-to-refresh des flux. La troisième, c’est l’absence de coûts sociaux pour se déconnecter : tu ne peux pas sortir d’un groupe WhatsApp sans passer pour grossier. La quatrième, c’est l’attachement artificiel à des métriques — likes, vues, streaks Snapchat, followers. La cinquième, c’est l’exploitation de l’ennui : au moindre temps mort, la poche sonne.

Harris quitte Google fin 2015. Il fonde le Center for Humane Technology, lance le mouvement Time Well Spent, et popularise en 2019 l’expression « human downgrading » pour désigner un système interconnecté d’addictions, de polarisations et de désinformations qui se renforcent mutuellement. En 2020, il est la figure centrale du documentaire Netflix The Social Dilemma, vu par environ 100 millions de personnes. Sa formule la plus citée y tient en une phrase : « Jamais dans l’histoire cinquante designers n’ont pris des décisions qui affecteraient deux milliards de personnes. »

Ce que Harris apporte que les analyses académiques ne peuvent pas fournir, c’est le témoignage interne. Pas seulement « on soupçonne que ». Mais « j’étais dans la pièce, voilà ce qu’on a discuté, voilà les arbitrages qu’on a faits ». Le passage du soupçon à la preuve documentée.

Que montrent vraiment les documents Haugen ?

Huit ans après la présentation de Harris, le 5 octobre 2021, une autre employée de plateforme passe à l’étage au-dessus. Frances Haugen, ancienne cheffe de produit sur l’équipe Civic Misinformation de Facebook, témoigne devant le sous-comité du Sénat américain sur la protection des consommateurs. FACTUEL Elle a transmis au Wall Street Journal et à la SEC des dizaines de milliers de documents internes. Ce qui n’était qu’hypothèse devient fait démontré.

Trois révélations sont majeures.

Première révélation. L’algorithme dit downstream Meaningful Social Interactions (MSI), déployé en 2018, a augmenté la visibilité des contenus générant colère et indignation, parce que ceux-ci produisent mécaniquement plus de partages et de commentaires. Les équipes internes de data science avaient alerté la direction sur ces « effets secondaires malsains ». Les correctifs ont été bloqués — parce qu’ils réduisaient l’engagement. Autrement dit : la direction savait, mesurait, et a choisi.

Deuxième révélation. Les propres recherches d’Instagram, restées internes, montraient que 13,5 % des adolescentes britanniques interrogées déclaraient que l’application aggravait leurs pensées suicidaires, et 17 % aggravait leurs troubles alimentaires. Un autre chiffre circule : 32 % des filles ayant déjà une mauvaise image de leur corps disent qu’Instagram l’aggrave. Ces études sont documentées dans les Facebook Files du Wall Street Journal et ont été confirmées par Haugen lors de son interview à 60 Minutes et de son audition au Sénat.

Troisième révélation. Les systèmes d’intégrité et de modération étaient presque entièrement anglophones. Dans les marchés non anglophones, où les algorithmes amplifiaient des violences ethniques (Éthiopie, Myanmar) et des campagnes de désinformation, la plateforme n’avait littéralement personne pour lire le contenu.

La phrase-clef du témoignage résume l’accusation : « Facebook a choisi à plusieurs reprises d’optimiser pour ses propres intérêts — comme gagner plus d’argent — plutôt que pour la sécurité publique. » Ce que Haugen démontre, c’est que l’exploitation n’est pas un effet pervers. C’est un choix architectural rationnel, connu, documenté, maintenu.

Que dit vraiment la science sur les effets des réseaux sociaux ?

Ici, honnêteté scientifique. Le discours militant va plus vite que les preuves. EXPLORATOIRE

Le psychologue américain Jonathan Haidt a publié en 2024 The Anxious Generation — un best-seller qui défend une thèse simple : l’arrivée du smartphone et des réseaux sociaux vers 2010 a provoqué une crise de santé mentale sans précédent chez les adolescents, particulièrement les filles. Haidt propose quatre réformes radicales : pas de smartphone avant le lycée, pas de réseaux sociaux avant 16 ans, écoles sans téléphone, plus de jeu libre en extérieur.

La réponse est venue vite. Dans la revue Nature, en mars 2024, la psychologue du développement Candice Odgers a signé une recension sévère. Son argument central : Haidt confond corrélation et causalité. Que les courbes d’usage du smartphone et celles des troubles mentaux adolescents montent en parallèle ne prouve pas que l’une cause l’autre. Beaucoup d’autres facteurs ont changé dans les mêmes années — pression scolaire, incertitude économique, polarisation politique, diffusion de langages psychiatriques dans la culture pop. Les méta-analyses sérieuses, selon Odgers, ne trouvent que des effets faibles à modérés, souvent de l’ordre du bruit statistique.

Qui a raison ? La vérité honnête est : personne ne sait encore trancher. Haidt a répondu publiquement en insistant sur les études longitudinales et expérimentales qu’Odgers, selon lui, a ignorées. Des chercheurs comme Amy Orben et Andrew Przybylski (Oxford Internet Institute) ont montré depuis des années que l’effet des écrans sur le bien-être adolescent, quand il existe, est du même ordre de grandeur que l’effet de manger des pommes de terre — quasi nul en moyenne, mais potentiellement plus fort pour certains profils. Jean Twenge, elle, défend l’inverse. Le débat est actif, les données sont massives, les méthodes ne s’accordent pas.

Un point en revanche fait consensus croissant : le lien entre polarisation politique et algorithmes de recommandation apparaît plus robuste dans les travaux publiés depuis 2023 dans Science et Nature, même si leur ampleur reste débattue.

Il reste trois grandes incertitudes que cet article ne peut pas résoudre. La causalité : les plateformes aggravent-elles une vulnérabilité préexistante ou la créent-elles ? La réversibilité : le DSA européen et les lois américaines sur les mineurs vont-ils modifier les comportements de fond ou juste l’emballage ? Et la nouvelle frontière : ChatGPT, les vidéos synthétiques, les agents conversationnels ouvrent depuis 2023 une extraction attentionnelle d’un type nouveau, dont nous n’avons pas encore de cadre critique solide.

Dans ma peau, qu’est-ce que ça change ?

Je connais ces mécanismes et je scrolle quand même à 23h. Ce n’est pas un aveu dramatique : savoir comment la machine est construite ne m’en fait pas sortir. Ça m’apprend juste pourquoi la seule volonté individuelle, face à un dispositif testé sur des milliards d’essais, ne suffit pas. EXPÉRIENCE

Il y a, en gros, trois leviers disponibles aujourd’hui, et aucun des trois n’est magique.

Premier levier, la régulation publique. FACTUEL Le Digital Services Act européen, applicable depuis février 2024, oblige les très grandes plateformes à auditer leurs risques systémiques. Plusieurs États américains (Utah, New York, Californie) ont adopté en 2023-2024 des lois sur les mineurs. La France, via la DGCCRF, sanctionne les dark patterns. C’est lent, c’est partiel, mais c’est le seul étage où un rapport de force s’exerce réellement sur les modèles économiques.

Deuxième levier, la conception alternative. Les fonctionnalités de « bien-être numérique » — Android Pie 2018, iOS ScreenTime — mesurent le temps passé sans jamais le restreindre. Elles sont intéressantes à regarder comme symptôme : l’industrie reconnaît le problème au point de le quantifier, mais refuse de toucher au produit qui le crée. Les plateformes sans publicité (Substack, Patreon, fediverse) existent, mais pèsent peu face aux mastodontes.

Troisième levier, l’hygiène individuelle. Couper les notifications, revenir au défilement chronologique, passer le téléphone en niveaux de gris, laisser l’appareil dans une autre pièce le soir. Ces conseils circulent partout. Ils aident. Mais ils butent sur une asymétrie brutale : d’un côté un individu seul avec sa volonté, de l’autre une industrie de plusieurs centaines de milliards de dollars dont les ingénieurs passent leurs semaines à tester ce qui vient ronger cette volonté. Comme le dit Bronner, cette économie ne nous impose pas une nature étrangère, elle révèle et amplifie la nôtre. Ce n’est pas un ennemi extérieur. C’est nous, amplifiés par un dispositif.

Il faut ici mentionner une nuance qui dérange. Nir Eyal, l’auteur de Hooked, a publié en 2019 un deuxième livre intitulé Indistractable, où il défend la thèse opposée : si les gens sont captifs, c’est d’abord un problème de responsabilité individuelle, pas d’architecture. Des critiques ont noté que cette bascule rappelle la rhétorique de l’industrie du tabac des années 1960. C’est la même bascule argumentative : quand la nocivité devient indéniable, le discours migre de « notre produit est sans danger » à « c’est à chacun de gérer sa consommation ». Je ne dis pas qu’Eyal est de mauvaise foi. Je dis que quand l’inventeur du modèle de l’accroche défend quinze ans plus tard qu’il faut « juste être indistractable », on a le droit de lire la trajectoire comme un symptôme de plus du même marché cognitif. EXPLORATOIRE

Voir le verre tel qu’il est

Dans l’article manifeste de cette série, j’ai proposé une formule : voir le verre tel qu’il est, et s’intéresser à pourquoi on voit l’un ou l’autre. Cet article-ci demande d’appliquer cette formule non à notre vie intérieure, mais aux interfaces qui composent notre quotidien. Non pas « je suis faible » ou « je suis distrait », mais : comment cet objet est-il construit, par qui, pour qui, et à quel prix ?

Les mécaniques que je viens de décrire ne font pas de ceux qui les ont bâties des monstres. Beaucoup croyaient, en 2010, construire des outils d’émancipation. Beaucoup le croient encore. La machine s’est emballée plus vite que la conscience de ceux qui la faisaient tourner. C’est pour ça que les regrets publics d’Aza Raskin, de Tristan Harris, de Justin Rosenstein (l’inventeur du bouton Like) ont quelque chose de précieux : ils disent depuis l’intérieur que le dispositif n’est pas neutre.

Deux articles à venir de cette série prolongent le questionnement d’un autre côté. Le quatrième s’attaque à une formule spécifique du développement personnel — « l’argent est une énergie » — pour montrer comment certaines idées spirituelles, dans le même marché dérégulé, finissent par produire exactement le type de confusion que les algorithmes exploitent. Le troisième met face à face deux promesses incompatibles du wellness : libérer des peurs, et vendre par la peur.

Pour ce soir, une seule chose pratique, si l’envie vient : avant de relire ces articles, coupe les notifications de ton téléphone pour une heure. Pas pour montrer une vertu. Pour voir, dans ta propre peau, si l’attention revient.

À lire aussi dans cette série :